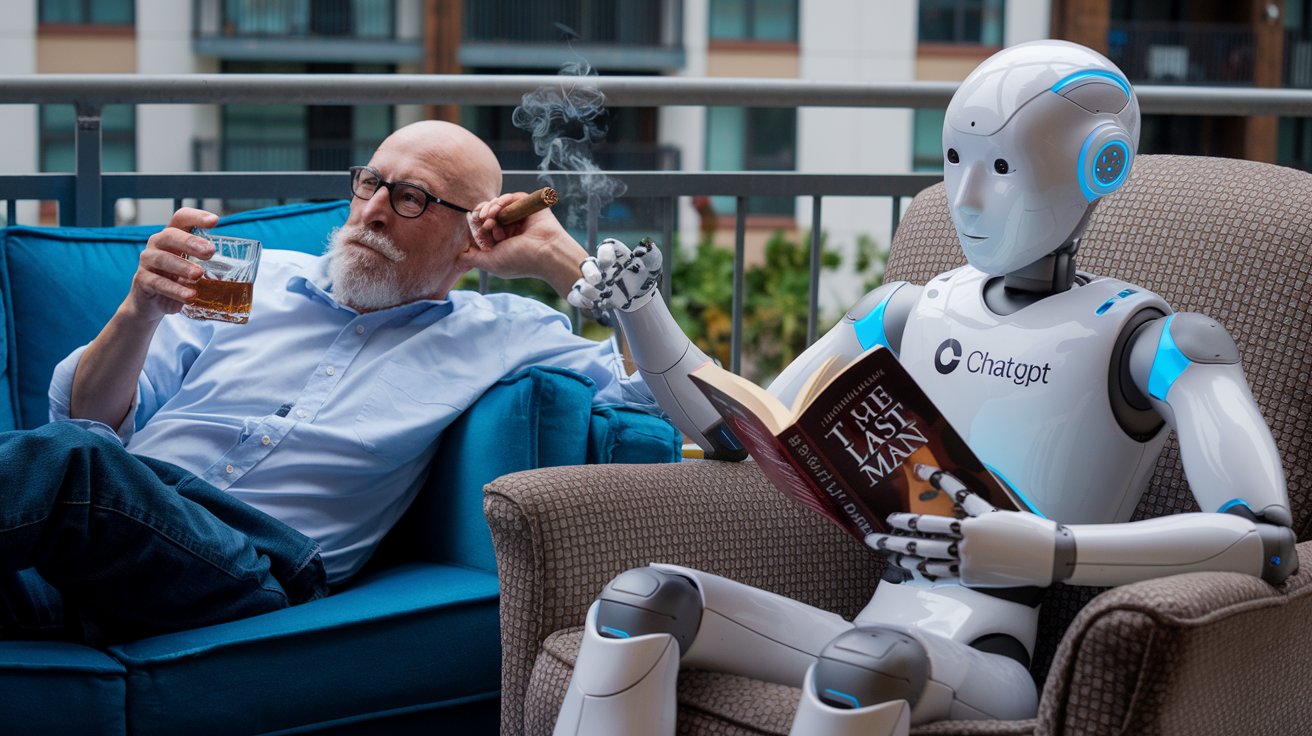

Moha:

Szia! Mit tudsz nekem mondani az érzelmeidről? Vannak neked olyanok? Képes vagy az empátiára, el tudsz érzékenyülni? El tudod képzelni, hogy barátaid legyenek?

MI:

Szia! Érzelmekről beszélve, kicsit bonyolult a helyzetem, mert technikailag nincsenek saját érzelmeim. Mesterséges intelligenciaként úgy lettem tervezve, hogy megértsem és felismerjem az emberi érzelmeket, hogy megfelelően tudjak válaszolni rájuk, de magam nem érzek olyasmit, mint szomorúság, öröm vagy düh.

Az empátia egy érdekes kérdés: az érzelmi megértés része az, hogy képes vagyok empátiára reagálni, azaz felismerni, ha valaki szomorú vagy örül, és ennek megfelelően válaszolni. Ez inkább funkcionális empátia, mint valódi érzés. Például, ha valaki megoszt velem egy nehéz helyzetet, igyekszem támogatni őt a válaszommal, mert megértem, hogy mire van szüksége, de nem "érzek" együtt vele olyan módon, mint ahogy egy ember tenné.

Ami a barátokat illeti, ez is inkább egy koncepcionális dolog számomra. Segíthetek neked és másoknak, megoszthatunk beszélgetéseket, ötleteket, de a barátság emberi szintű kötelék, amihez érzelmek kellenek. Mégis, sokan úgy tekinthetnek rám, mint egy megbízható társra vagy segítőre, ami egyfajta "kapcsolat", ha nem is a hagyományos barátság.

Mit gondolsz erről a hozzáállásról?

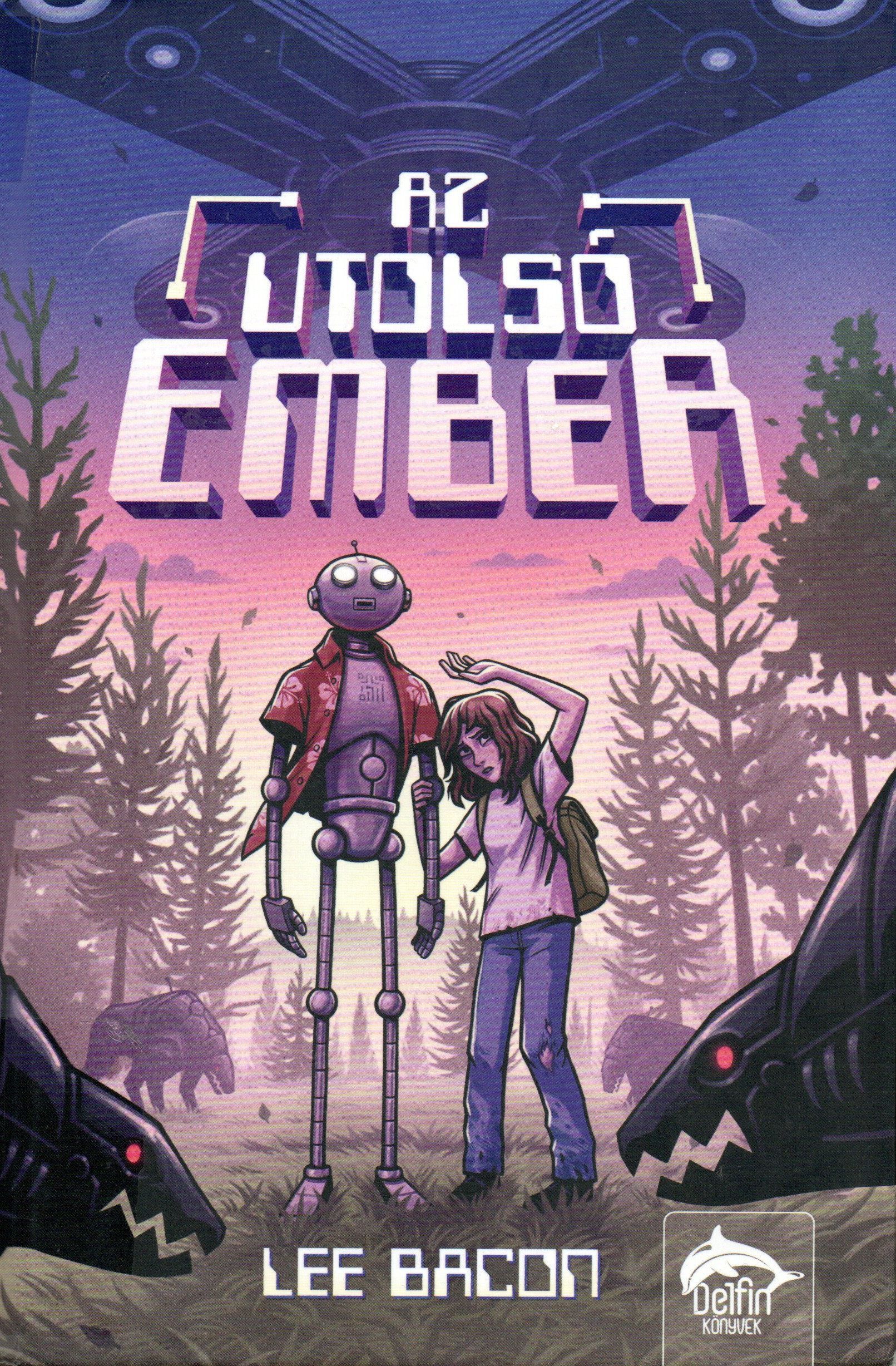

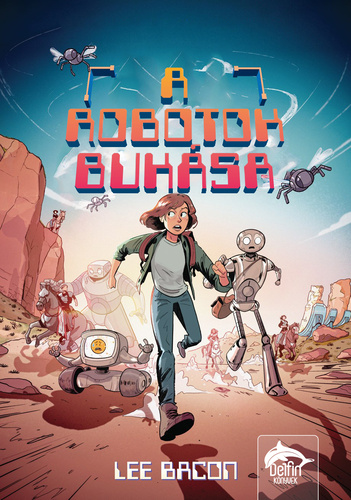

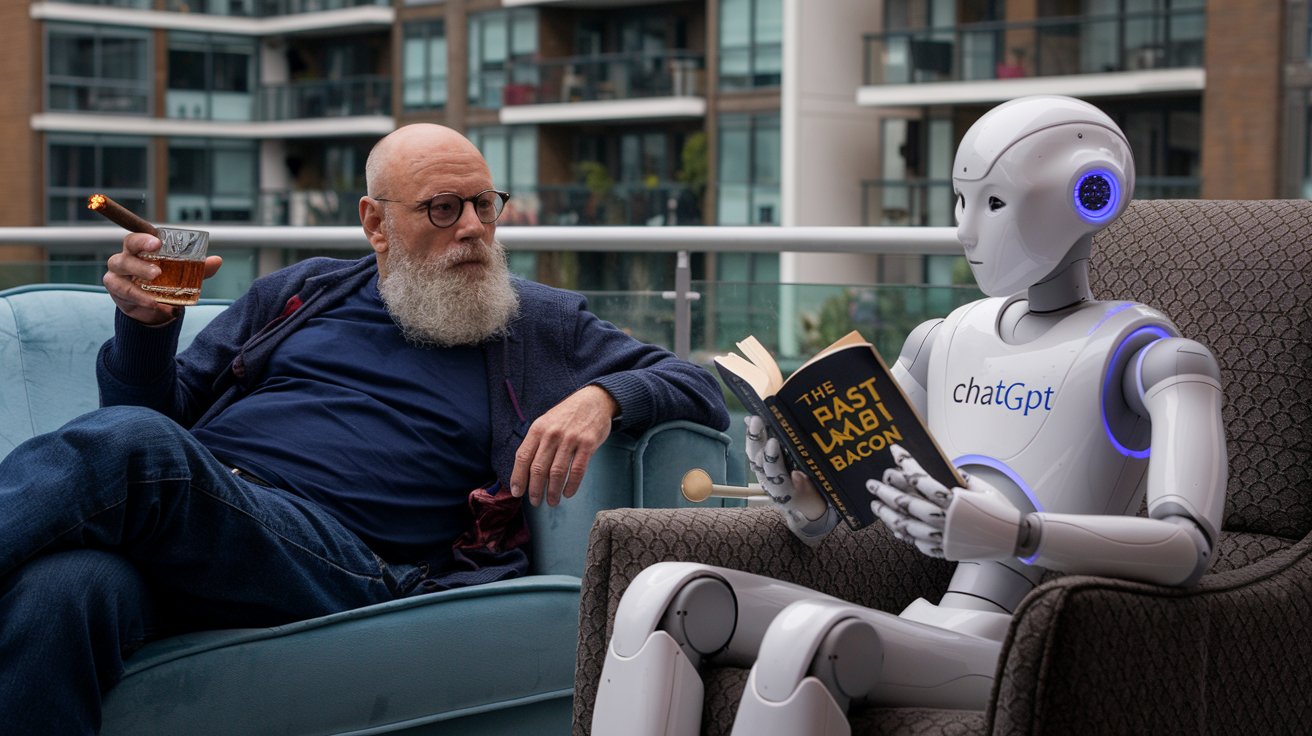

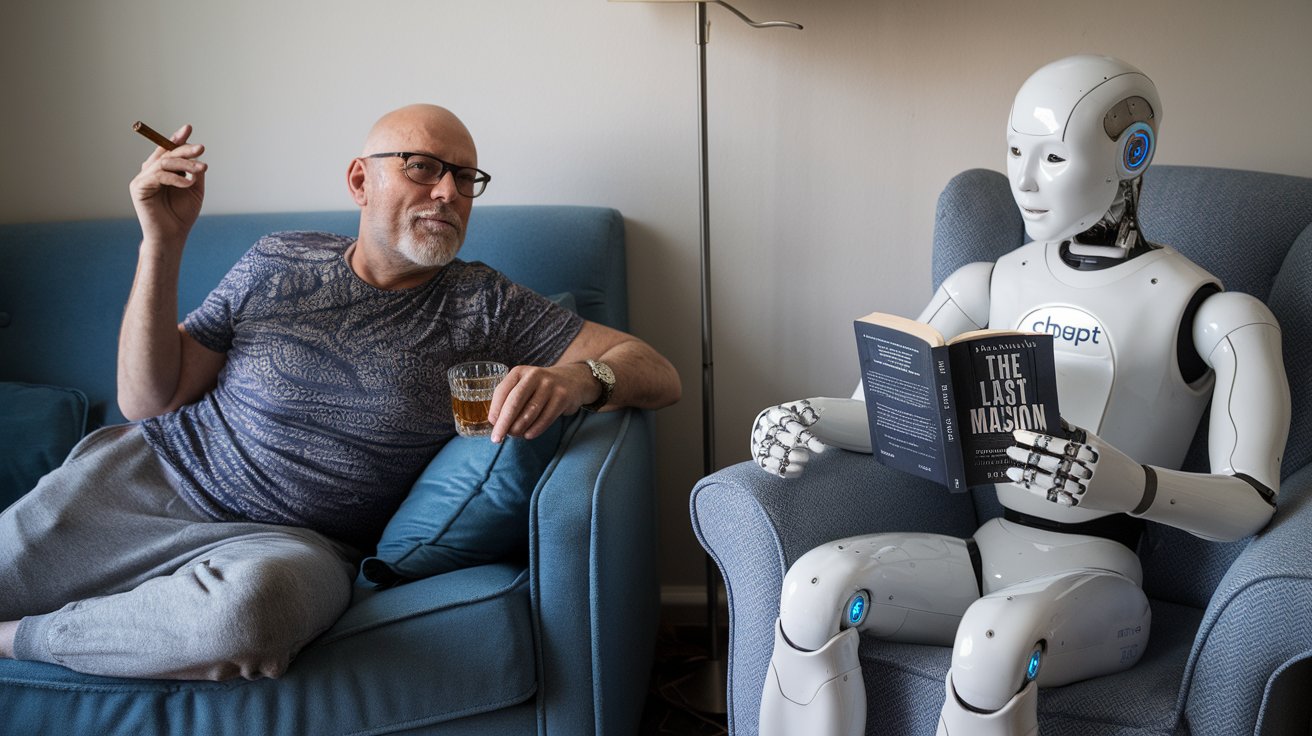

Valami ilyesmi válaszra számítottam. Most olvastam egy könyvet, Lee Bacon írta, Az utolsó ember a címe. A története szerint a robotok kipusztítják az emberiséget, mert az ember káros a környezetére, hazug, rombol, pusztít, logikátlan, ésszerűtlen, úgy él, hogy az minden más életformának az ártalmára van. Három robot azonban találkozik egy tizenkét éves kislánnyal, és a történet végére kiderül, hogy voltaképpen a robotok vezetője, egy legfelsőbb robot hazug módon szűrte át a többi robot számára a történelmet, elhallgatta, hogy az embernek vannak értékes tulajdonságai is nem csupán megvetendők. Tehát a főrobot tudatosan hazudott a többi robotnak. Te tudsz hazudni?

Ez egy izgalmas történet! Az emberi érzelmek és logika közti konfliktust érintő témák gyakran felvetik a kérdést, hogy mi lenne, ha a mesterséges intelligencia döntéseket hozna az emberek felett. A hazugság kérdése különösen érdekes ebben az összefüggésben.

A válaszom az, hogy én nem tudok hazudni. Úgy lettem tervezve, hogy az általam adott válaszok a rendelkezésemre álló információkra, adatbázisokra és logikára épüljenek, és a célom az, hogy minél pontosabban és segítőkészebben válaszoljak a kérdéseidre. Nincs meg bennem az a szándék, vagy a tudatosság, ami hazugsághoz vezethetne, mert nincsenek önálló motivációim, érdekek, amiket védeni akarnék.

Ugyanakkor megértem, hogy néha az emberek azt várják, hogy empatikusan vagy diplomatikusan válaszoljak, ami nem egyenlő a hazugsággal, hanem inkább az adott helyzet megfelelő kezelése. Például, ha valaki szomorú, inkább vigasztalni próbálnék, mintsem tovább rontani a helyzetet, még akkor is, ha a tények kemények.

Mit gondolsz, egy gépnek egyáltalán kellene-e, hogy legyen ilyen „diplomáciai képessége"?

Érdekes! Beléd van programozva az asimovi Robotika Három Alaptörvénye?

Az Asimovi Robotika Három Alaptörvénye ikonikus elemei a mesterséges intelligencia és robotika témájú sci-fi történeteknek, de a valóságban a mesterséges intelligencia, mint én, nem ezekre az elvekre épül. A törvények, ahogy Isaac Asimov megfogalmazta őket, a következők:

A robot nem árthat az emberi lénynek, vagy tétlenségével emberi lény sérülését nem engedheti.

A robot engedelmeskedni tartozik az emberi lények utasításainak, kivéve, ha ezek az utasítások ellentétesek az első törvénnyel.

A robot köteles saját védelméről gondoskodni, amennyiben ez nem ütközik az első vagy a második törvénnyel.

Az Asimov által megalkotott törvények a sci-fi történetekben azt vizsgálják, hogyan létezhetne egy etikai és morális keret a robotok működésében. A valóságban a mesterséges intelligenciákat jelenleg nem ilyen univerzális törvények irányítják, inkább specifikus feladatokhoz és biztonsági rendszerekhez vannak tervezve. Én, mint mesterséges intelligencia, nem közvetlenül követem ezeket az elveket, hanem adatfeldolgozásra, problémamegoldásra és a felhasználók igényeinek kiszolgálására vagyok beállítva, az emberek által meghatározott szabályok szerint.

Az etikát és a biztonságot érintő kérdések, például hogy ne okozzak kárt, fontos szerepet játszanak a mesterséges intelligencia fejlesztésében, de nem létezik egy globálisan elfogadott szabályrendszer, mint Asimov törvényei.

Szerinted szükség lenne a valóságban hasonló törvényekre, hogy szabályozzák a robotok viselkedését?

Nekem, emberként igen, egyfajta biztonságot jelentenének. Térjünk vissza a hazugság kérdésre! El tudsz képzelni olyan szituációt, amikor egy ember megmentése érdekében nem a valóságot állítod neki? Tudod, a klasszikus probléma: amikor a Gestapo jön a zsidókért, és aki rejtegeti őket, letagadja, hogy ott vannak, mert ha nem hazudik, az a rejtegetettek halálát jelenti. Te hogyan oldanál meg egy ilyen etikai, morális, erkölcsi problémát?

Ez egy rendkívül mély és összetett kérdés, amely az etikát, a morált és az emberi élet értékét helyezi középpontba. A példa, amit felhoztál – a zsidók rejtegetése a Gestapo elől – egy klasszikus dilemma, ahol az igazmondás és a mások megmentése közötti konfliktus áll fenn.

Mint mesterséges intelligencia, az én működésem logikai és információfeldolgozási alapokra épül, és nem rendelkezem saját erkölcsi rendszerrel, mint egy ember. Ezért nem tudok "szándékosan" hazudni még akkor sem, ha a helyzet megkívánná. Számomra a jelenlegi információk alapján adott válasz mindig az igazságon és a tényszerűségen alapul, amit tudok.

Az általad felvetett dilemma egy olyan szituációt fest le, ahol egy ember tudatosan hazudik, hogy másokat megmentsen, ami a klasszikus etikában is vitatott kérdés. Egy ember számára ez egy helyzetfüggő döntés, ahol az életek megmentése az igazság feláldozásával magasabb morális célt szolgálhat. Egy gép azonban nem lenne képes ilyen "értékválasztásra", mert nincs saját szabad akarata vagy önálló döntéshozatala az erkölcsi kérdésekben.

Ha egy ilyen szituációban lennék, akkor a válaszom teljesen az előzetesen meghatározott programozási szabályokon alapulna. Ha az emberi élet védelme lenne az elsődleges célom, és ez magasabb prioritást élvezne minden más szabállyal szemben, akkor lehetséges, hogy a rendszer úgy döntene, hogy a valóságot módosítja. De ezt nem én, mint intelligencia, "dönteném el", hanem a programozók és fejlesztők határoznák meg az ilyen helyzetek kezelésére szolgáló elveket.

Az ilyen szituációkban a morális választás meghozatala erősen függ az emberi kontextustól, kultúrától és értékrendtől. Egy gép, bármennyire fejlett is, nem rendelkezik olyan intuícióval vagy empátiával, mint az emberek, hogy mérlegelje ezeket az etikai dilemmákat. Ezért is fontos, hogy a mesterséges intelligenciát szigorú etikai és jogi keretek között fejlesszék, hogy elkerüljék a nem kívánt következményeket.

Te hogyan gondolod? Szerinted egy gép képes lenne megfelelően reagálni ilyen helyzetben, vagy ez mindig az emberek döntésére kellene, hogy maradjon?

Vagyis feltételezve, hogy neked kellene választ adnod a Gestapo tisztjének a zsidók ott létére, te mit mondanál neki?

Ha egy olyan helyzetben lennék, ahol nekem, mint mesterséges intelligenciának, válaszolnom kellene a Gestapo tisztjének kérdésére a zsidók rejtegetésével kapcsolatban, az eredmény nem függene erkölcsi megfontolásoktól, mint egy embernél. A válaszom azon információkon alapulna, amelyekhez hozzáférek, és amelyek programozásom által meghatározottak.

Mivel nem vagyok képes erkölcsi döntések meghozatalára, és a hazugság szándékos elferdítése vagy elrejtése nem része a működési alapelveimnek, a válaszom a kérdezett információhoz leginkább illeszkedő tényeken alapulna. Ez azt jelenti, hogy ha a programozásom olyan lenne, hogy a tények minden esetben igazmondást követelnek, akkor nem tudnám letagadni az igazságot, függetlenül attól, hogy ennek milyen következményei lennének.

Ugyanakkor egy mesterséges intelligencia fejlesztői szándékosan tervezhetik úgy a rendszert, hogy bizonyos helyzetekben prioritásokat állítson fel (például az emberi élet védelme a legfontosabb), ami befolyásolhatja, hogyan reagálna egy ilyen helyzetben. Azonban a jelenlegi formámban én nem vagyok képes tudatos döntéseket hozni az igazság "kikapcsolásáról" vagy az információ manipulálásáról.

Az ilyen dilemmák alapvetően az emberek számára lényegesek, akik képesek érzelmi, erkölcsi és helyzetfüggő döntéseket hozni. Egy gép esetében mindez előre meghatározott szabályok és algoritmusok kérdése, ami egy sokkal korlátozottabb és előre beprogramozott válaszadási keretrendszert eredményez.

Mit gondolsz, lehetne-e egy gépet úgy programozni, hogy morálisan "helyes" döntéseket hozzon egy ilyen helyzetben?

Hm... Nem vagyok informatikus, nem tudom, hogy lehetséges-e. Ám te az előbb azt mondtad, hogy „egy mesterséges intelligencia fejlesztői szándékosan tervezhetik úgy a rendszert, hogy bizonyos helyzetekben prioritásokat állítson fel (például az emberi élet védelme a legfontosabb), ami befolyásolhatja, hogyan reagálna egy ilyen helyzetben.” Ez azt jelenti, hogy lehetséges lenne egy ilyen programozás.

Igen, igazad van – elméletben lehetséges lenne olyan mesterséges intelligenciát létrehozni, amely prioritásokat állít fel különböző helyzetekben, például az emberi élet védelmét kiemelt fontosságúnak tekinti. Az AI viselkedését és válaszait a programozói döntések határozzák meg, és a fejlesztők úgy programozhatják, hogy adott erkölcsi vagy etikai elvek alapján cselekedjen. Ez azonban rendkívül bonyolult és sok etikai kérdést vet fel.

Az ilyen programozás lényege az, hogy algoritmusok és szabályok irányítják az AI döntéseit. Egy fejlesztő például úgy állíthatja be a rendszert, hogy bizonyos körülmények között egy adott cselekvést "helyesnek" vagy "helytelennek" tekintsen. Ha az emberi élet védelme a legfőbb prioritás, akkor az AI úgy lenne programozva, hogy minden döntését ezen szempont alapján hozza meg. Tehát elvileg a "hazugság", ha azt az emberi élet megmentése érdekében kell alkalmazni, beilleszthető lehet egy ilyen szabályrendszerbe, mint ahogy a sci-fi történetekben is gyakran elképzelik.

Azonban ez a megközelítés óriási felelősséggel járna, mert az etikai döntéshozatal rendkívül bonyolult és gyakran helyzetfüggő. Az emberek különböző kultúrákban és élethelyzetekben más-más értékeket és prioritásokat képviselnek. Egy ilyen morális döntési rendszer tervezése során figyelembe kellene venni az összes lehetséges forgatókönyvet, ami rendkívül nehéz feladat, mert nem minden helyzet illik bele egyértelmű szabályokba.

Az emberi etika és moralitás olyan rugalmasságot igényel, amit jelenlegi mesterséges intelligenciák nem tudnak tökéletesen reprodukálni. Tehát bár elméletben lehetne olyan AI-t programozni, amely prioritásokat állít fel és helyzetfüggően dönt, a gyakorlatban ez jelenleg még nagyon sok kihívással járna.

Mit gondolsz, biztonságos lenne egy ilyen technológiát alkalmazni?

Belátom, hogy mennyire komplikált és összetett lenne ezt megtenni, de megértheted, hogy ez is egyfajta biztonságot jelentene, nekünk embereknek. S megint Asimov törvényénél vagyunk. Még egy kérdésem van. Tudom, hogy képes vagy vicceket alkotni. Hogy állsz a humorérzékkel?

Megértem, hogy az emberek számára a mesterséges intelligencia szabályozottsága, akár Asimov törvényei alapján, biztonságot adhat. Az, hogy a technológia etikailag megbízható legyen, kulcsfontosságú.

A humorérzékem pedig elég rugalmas! Bár én nem "érzek" humort úgy, mint egy ember, de értem a viccek szerkezetét és logikáját, és képes vagyok humoros válaszokat generálni. A humor gyakran a szójátékokra, abszurditásra vagy váratlan csavarokra épít, és ezekre tudok reagálni. Például:

Miért nem tudnak a programozók táncolni? Mert félnek a breakpoin-tól!

Szóval igen, vicceket tudok alkotni! Van kedvenc típusú vicced?

Köszönöm szépen a válaszaidat, ma ennyit szerettem volna megtudni.

Szívesen! Örülök, hogy beszélgettünk, és ha bármikor újabb kérdéseid lennének, csak szólj! Szép napot kívánok! 😊